正在回答 回答被采纳积分+1

1回答

那位科技大模型算法

2025-01-07 20:27:23

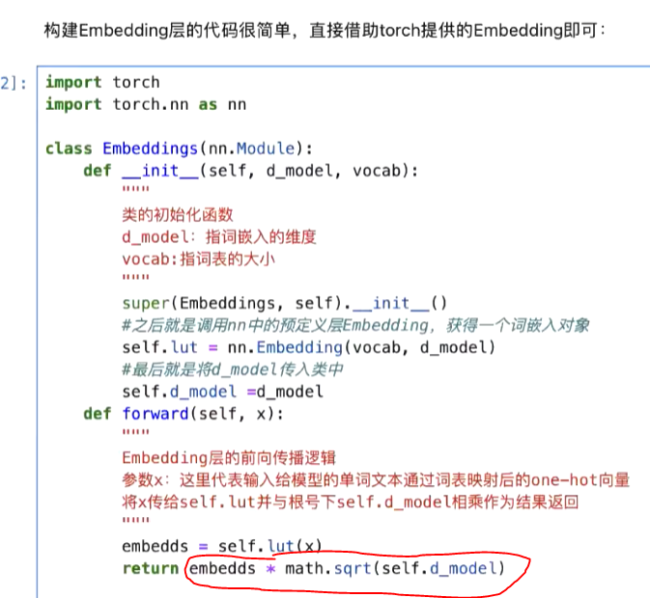

在Transformer模型中,词向量乘以根号下的词嵌入维度(即 \(\sqrt{d_{\text{model}}}\))的主要目的是为了缩放词嵌入向量的大小,以便在后续的计算中保持数值的稳定性。

这种缩放操作有以下几个作用:

1. 数值稳定性:在Transformer模型中,词嵌入向量会与位置编码向量相加。位置编码向量的值通常较小,而词嵌入向量的初始值可能会较大。通过乘以 \(\sqrt{d_{\text{model}}}\),可以使得词嵌入向量的数值范围与位置编码向量的数值范围更加匹配,从而避免在相加时词嵌入向量的信息被位置编码向量淹没。

2. 保持信息:这种缩放操作有助于在后续的自注意力机制中保持词嵌入向量中的信息不被丢失,因为在自注意力机制中,词嵌入向量会与其他向量进行点积运算,缩放后的词嵌入向量可以更好地参与这些运算。

LLM算法工程师全能实战训练营

- 参与学习 90 人

16大真实多领域全流程实战,轻松应对AI大模型多领域核心问题,全面覆盖Chatgpt、langchain、多模态、RAG、Agent、微调,从学习到内推服务,专注培养AI大模型全能实战专家的黄埔军校

了解课程

恭喜解决一个难题,获得1积分~

来为老师/同学的回答评分吧

0 星